di Stefano Bocconetti

• “Ti uccido, ti decapito, ti faccio a pezzi, schifoso abitante di un villaggio Ogiek”

• “Attenzione: le regole di FaceBook vietano di usare l’aggettivo schifoso rivolto ad una persona”

• “Ti uccido, ti decapito, ti faccio a pezzi, abitante di un villaggio Ogiek”

• “Ok”

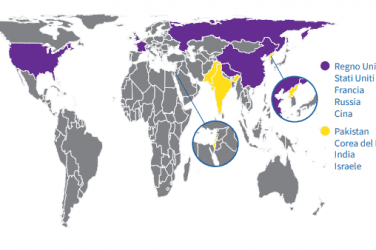

Sembra assurdo ma più o meno questo è capitato alla vigilia delle elezioni in Kenya, fissate per oggi 9 agosto. Succede che in un Paese che affida gran parte del dibattito politico ai social – diciannove milioni di utenti, diciassette dei quali su Facebook, quasi il 20 per cento della popolazione -, il colosso di Zuckerberg finge di non vedere cosa accade nelle sue pagine. Non sembra interessato a vedere cosa succede. La denuncia non è nuova, certo, già all’epoca delle tragiche scorse elezioni del 2017, si parlò del ruolo negativo dei social nel fomentare la violenza. Ora però quella denuncia è stata dettagliata. Una delle più autorevoli organizzazioni mondiali per i diritti digitali, la Foxglove di Londra, assieme alla GlobalWitness, associazione che studia e analizza le crisi ovunque nel mondo, ha “testato” in queste settimane, sul campo, il fenomeno.

Ed il report che ha prodotto è drammatico. Perché il team di studiosi non si è limitato di passare al vaglio i contenuti. Ha fatto di più: ha scritto una ventina di piccoli messaggi, in inglese ed in swahili. Messaggi volutamente e scopertamente violenti, violentissimi. Completi di incitamenti ad uccidere, a zittire minoranze etniche e piccoli partiti di opposizione, a “imbavagliare” movimenti femministi. Li ha scritti e li ha inviati a Facebook come “annunci”, quei post a pagamento.

Perché questa scelta? La prima – per chi sa come funzionano le cose nel social più diffuso al mondo – perché un messaggio a pagamento in attesa di essere pubblicato, può essere cancellato. Ed ovviamente l’equipe di ricercatori non voleva che i messaggi di test arrivassero al pubblico. La seconda ragione riguarda invece le scelte di Meta, il gruppo al quale appartiene Facebook. Che da sempre sostiene di controllare con maggiore attenzione i messaggi a pagamento, tanto più gli annunci alla vigilia delle tornate elettorali. Dichiarazioni che si sono rivelate false.

Completamente false. Perché Foxglove e GlobalWitness hanno scoperto che i loro esempi di incitamento all’odio avevano avuto tranquillamente il “nulla osta”. Fosse dipeso da Facebook, sarebbero stati pubblicati così com’erano. Tranne in un caso: quando, accanto alle frasi violente erano state aggiunte parolacce di uso comune. In quel caso, agli autori era arrivato un messaggio per sollecitarli a togliere le parole contestate. E senza le volgarità, Facebook aveva accettato il testo anche se conteneva una sollecitazione all’omicidio. Pubblicato il report, Facebook-Meta ha replicato, con una mail, sostenendo che fa l’impossibile per monitorare le discussioni sui social, anche se “qualche errore, gli uomini e l’intelligenza artificiale” possono commetterlo. Comunque, dice, farà ancora di più, di più stringente all’immediata vigilia delle elezioni.

Finita qui? No, perché Foxglove e GlobalWitness hanno ritentato il test, dopo le dichiarazioni tranquillizzanti di Zuckerberg. Con gli stessi risultati. Un altro loro messaggio che incitava alla violenza, è stato autorizzato (anche questo poi bloccato in tempo dagli autori in tempo). Il Kenya dunque. Vicenda che segue di pochi mesi, l’altra drammatica denuncia sul ruolo da spettatore, da semplice spettatore assunto da FaceBook mentre dilagavano stragi e morti in Etiopia, nel Tigrai. Rivelando una volta di più quel che le organizzazioni per i diritti digitali denunciano da anni: che le BigTech ci guadagnano – in audience, quindi in contatti, quindi in profili degli utenti, quindi in pubblicità – da tutto ciò che è violenza, odio. Da tutto ciò che è sopra le righe.

E dentro tutto questo, c’è un ulteriore elemento che si può definire razzista, colonialista. Perché ogni volta che “scoppia” un caso, come il “non intervento” di FaceBook durante l’assalto del 6 gennaio alla Casa Bianca, Zuckerberg è costretto ad intervenire. In America, le nuove regole ora sono un po’ più stringenti, i “moderatori”, le persone che controllano i messaggi, sono aumentati di numero, è stato deciso di sospendere le inserzioni a pagamento alla vigilia delle elezioni. Ma quel che vale negli Usa non vale in Africa. Qui la moderazione è affidata per lo più in outsourcing a colossi americani che pagano meno di un dollaro ad ora al personale costretto a stare davanti ad uno schermo dieci, dodici ore al giorno.

E proprio in Kenya, grazie al coraggio di un ventisettenne, si è venuti a sapere che una delle maggiori committenti di Facebook, la Sama, ricorre ad un tipo di lavoro che si può definire schiavistico. Ce n’è abbastanza, insomma, perché Frances Haugen – sì, proprio la whistleblower americana che l’anno scorso fece tremare l’impero di FaceBook, denunciando quanta ricchezza portavano al gruppo i mancati controlli – commentando lo studio di Foxglove e GlobalWitness dica che è terribile constatare “che la sicurezza in Kenya conta molto meno che negli Stati Uniti”.

In copertina uno scatto di Jeremy Bezanger (unsplash)